まずは「やってはいけない事」だけ決める。実態に即した「社内規定」の作り方

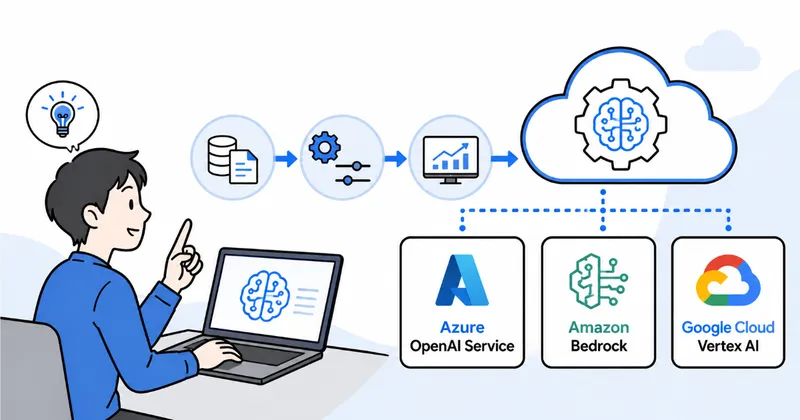

生成AIの社内導入において、最初から完璧なルールを作ることは不可能です。本コラムでは、「機密情報の入力禁止」など最低限のNG事項のみを定めて小さく始めるアプローチと、公的機関が提供する「ひな形」を活用した、実態に即した現実的な社内規定の作り方を解説します。

1. 完璧なルールを求めて立ち止まるリスク

生成AIの業務利用を進めるにあたり、社内の推進担当者や管理部門が最初に直面する壁が「社内規定(ガイドライン)の策定」です。

「情報漏洩が起きないよう、あらゆるリスクを想定して完璧なルールを作らなければならない」「著作権法や個人情報保護法の観点から、法務部門と何ヶ月もかけて文言を練らなければならない」。真面目な担当者ほど、このように考えてしまいがちです。

しかし、AI技術は数ヶ月単位で劇的なアップデートを繰り返しています。時間をかけて重厚長大なルールブックを作っている間に、技術の前提が変わり、ルール自体が時代遅れになってしまうことは珍しくありません。また、ルール作りを理由に公式な導入を長期間ストップしてしまうと、現場の従業員は待ちきれず、個人の判断で未許可のAIアプリを使い始める「シャドーIT」が蔓延するリスクが高まります。

実務における社内規定の策定は、「完璧さを求めて立ち止まること」よりも、「最低限の安全を確保して、まずは使い始めること」を優先すべきです。

2. 最初は「やってはいけない事(NG事項)」だけを決める

現実的な社内規定を作るための第一歩は、ルールを「従業員に守らせる細かなマニュアル」ではなく、「これだけは絶対にやってはいけないという境界線(ガードレール)」と位置づけることです。

最初から数十ページに及ぶマニュアルを作る必要はありません。A4用紙1〜2枚程度で構わないので、以下のようなどんな企業でも共通する「最低限のNG事項」を明確に言語化します。

- 入力データの制限: 顧客の個人情報、未発表の業績データ、他社と秘密保持契約(NDA)を結んでいる情報など、機密性の高い情報は決して入力しない。

- ツールの指定: 業務でAIを利用する場合は、会社が許可・契約した公式環境(法人向けプラン等)のみを使用し、個人の無料アカウントで業務データを処理しない。

- 出力結果の鵜呑み禁止: AIの回答には事実誤認(ハルシネーション)が含まれる可能性があるため、最終的な事実確認と判断は必ず人間が行う。

- 著作権への配慮: AIが生成した文章や画像をそのまま外部へ公開する場合は、他者の著作権を侵害していないか確認する。

このように「NG事項」だけをシンプルに明示することで、現場の従業員は「この境界線さえ超えなければ、あとは自由にAIを使って業務を効率化していいのだ」と理解し、安心してツールを活用できるようになります。

3. ゼロから作らない:「ひな形」の賢い活用法

とはいえ、法律やセキュリティに関わる規定の文言を、担当者がゼロから書き起こすのは負担が大きすぎます。そこで強く推奨されるのが、外部の信頼できる機関が公開している「ガイドラインのひな形(テンプレート)」の活用です。

例えば、日本ディープラーニング協会(JDLA)は、企業向けの「生成AIの利用ガイドライン」のひな形を無料で公開しています。このひな形には、著作権、個人情報保護、営業秘密の取り扱いなど、法的に押さえておくべき基本的な条項があらかじめ網羅されています。

推進担当者はこのひな形をベースとしてダウンロードし、「自社の実態に合わない部分を削る」「自社特有のNG事項(特定の業務システムとの連携禁止など)を追記する」といったカスタマイズを行うだけで、法的な妥当性を担保しつつ、非常に短期間で実用的な社内規定を作成することができます。

4. ルールは「アジャイル(柔軟)」に見直す前提で

社内規定を「一度作ったら変えられない絶対的な法律」として扱うのはやめましょう。AIに関する社内規定は、技術の進化や現場の実態に合わせて常にアップデートしていく「生きたドキュメント」であるべきです。

例えば、「最初はリスクを考慮して顧客向けメールの作成には使用禁止としていたが、半年間運用して問題が起きず、従業員のリテラシーも上がってきたので、上長の確認を条件に利用を解禁する」といったように、状況を見ながら制限を緩和していくことも重要です。

そのためには、規定の末尾などに「本ガイドラインは、AI技術の動向や法令の変更に伴い、定期的に見直しを行うものとする」といった文言を入れておき、アジャイル(柔軟・俊敏)に運用していく姿勢を明示することが効果的です。

5. まとめ:ルールは「縛るため」ではなく「安心して使うため」

社内規定の本来の目的は、従業員の行動をガチガチに縛り、新しいことへの挑戦を邪魔することではありません。それは「このルールさえ守っていれば、意図せず会社に損害を与えてしまうことはない」という、従業員を守るためのセーフティネットです。

まずは「やってはいけないこと」だけを明確にしたシンプルな規定からスタートし、現場で実際に使いながら、自社の文化や業務の実態に合わせてルールを育てていく。この現実的でスピーディーなアプローチこそが、リスクを抑えつつAIの恩恵を組織全体に行き渡らせるための最適なスタートラインとなります。

この記事の監修者

石崎 一之進

中小企業診断士

年間50回以上のセミナー・研修に登壇する「Web・ITが得意な中小企業診断士」。単なるツール導入ではなく、経営視点から現場の「業務効率化」と「売れる仕組み」づくりを両輪で伴走支援し、企業の自走を促すDX人材育成に力を入れています。

参考文献

- 日本ディープラーニング協会(JDLA)「生成AIの利用ガイドライン(ひな形)」 https://www.jdla.org/document/

- 経済産業省・総務省「AI事業者ガイドライン(第1.0版)」 https://www.meti.go.jp/shingikai/mono_info_service/ai_shakai_jisso/pdf/20240419_1.pdf