Mac miniでも動く時代に。ローカルLLMの「安い構築」と「高くつく運用」のリアル

「機密情報を絶対に出さない」ローカルLLM。かつては数千万の投資が必要でしたが、今は数十万円のMac等で手軽に構築できる時代です。しかし「PCで動く」ことと「全社で実務に使える」ことは別物。安価な構築の裏に潜む、オープンソースの精度限界や運用エンジニア不足という「見えない運用コスト」の泥沼を解説します。

1. 数千万のサーバーは過去の話。数十万円で動くローカルLLM

企業のAI導入において、「我が社の機密情報や顧客データを、いくら安全とはいえ外部のクラウドサービス(OpenAIなど)に出したくない」というセキュリティ上の強い要望は常に存在します。これを解決する究極の手段が、自社のネットワーク内でAIを完結させる「ローカルLLM」です。

少し前まで、ローカルLLMをビジネスで動かすには、数千万円もする超高性能なGPUサーバー(NVIDIA製のハイエンド機など)を自社に導入しなければならないと言われていました。しかし技術の進化はすさまじく、現在の状況は全く異なります。

Meta社の「Llama」シリーズなどをはじめとする優秀なオープンソースモデルの軽量化が進み、現在では数十万円で買える市販の「Mac mini」や「Mac Studio(Apple Silicon搭載機)」、あるいはゲーミングPCさえあれば、十分にローカルLLMを構築・稼働できるエコシステムが完成しています。 ハードウェアの初期投資という巨大な壁は、すでに崩れ去ったと言っても過言ではありません。

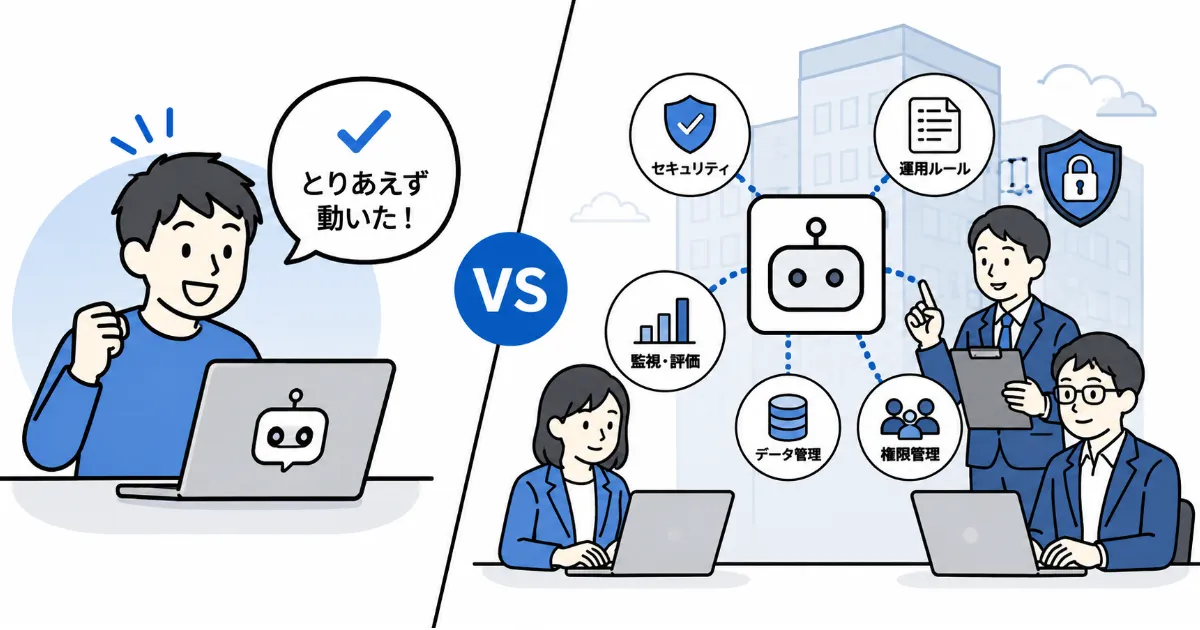

2. 誤解:「とりあえず動いた」と「全社で使える」は全くの別物

ハードルが劇的に下がったことで、「これならうちの会社でも、情シスにMacを買わせて安全なローカルAIを作れるじゃないか!」と飛びつく経営者や推進担当者が増えています。しかし、ここに大きな落とし穴があります。

数十万円のPCで「とりあえずAIが返事をしてくれた(動いた)」というレベルと、それを「全社員がアクセスする社内システムとして、日々の業務に耐えうる精度と安定性で提供する」というレベルの間には、天と地ほどの開きがあるのです。

ローカルLLMの本当の泥沼は、安価に構築した「その後の運用フェーズ」に待ち受けています。

3. 影の現実①:オープンソースモデルの「精度」という壁

Macで手軽に動かせるような軽量なオープンソースLLMは、日々進化しているとはいえ、やはり天文学的な資金を投じて開発・運用されている巨大な商用モデル(GPT-4やClaude 3など)と比較すると、「ビジネスレベルの複雑な日本語の文脈理解」や「推論の深さ」において見劣りする場面が多々あります。

そのまま動かしただけでは、意味不明な回答やもっともらしい嘘(ハルシネーション)の発生率が高く、現場の社員からは「このAI、使えないから結局自分で書いた方が早い」と見放されてしまいます。 これを実務に耐えうるレベル(自社専用の賢いAI)に引き上げるためには、自社で「ファインチューニング」を行ったり、「RAG(検索拡張生成)」の仕組みを自力で構築したりと、モデルを「調教」し続ける終わりのない作業が必要になります。

4. 影の現実②:最大の壁「保守運用できるエンジニアの不在」

そして、ローカルLLM運用において最も深刻な課題が「人材」です。

数十万円のMacでローカルLLMを立ち上げる「最初の構築」自体は、ネット上のマニュアルを見ながらITに明るい社員が週末にできてしまうかもしれません。しかし、問題はその後の保守運用です。

- 新しくて賢いオープンソースモデルが発表された時、自社のシステムにどうやって安全にアップデートを適用するのか?

- 全社員が同時にAIに質問してシステムが重くなった(パンクした)時、どうやってサーバーへの負荷を分散させるのか?

- RAGの検索精度が悪くなった時、データベースのチューニングを誰がやるのか?

これらは、従来の社内SEやネットワークエンジニアの知識だけでは対応できない、極めて専門性の高いAIインフラのスキルです。こうしたエンジニアは市場で激しい争奪戦となっており、一般的な企業が専任で雇い続けるのは非常に困難です。 「AIに詳しい担当者が一人で保守していたが、彼が転職してしまい、社内のローカルAIが誰も触れないブラックボックスになった」という笑えない事態が実際に起こり得ます。

5. 影の現実③:結局高くつく「見えない運用コスト」

ハードウェアの初期投資が「数十万円」で済んだとしても、それを実用レベルに引き上げるためのデータ整備、モデルの調整、セキュリティパッチの適用、そしてそれらを行うための人件費(または外部ベンダーへの委託費)を合算するとどうなるでしょうか。

結果的に、クラウドのエンタープライズ版(法人向けプラン)を契約して毎月数万円〜数十万円の利用料を払うよりも、自前でローカルLLMを維持する「見えない運用コスト」の方が圧倒的に高くついてしまった、というケースは珍しくありません。

6. まとめ:自社の「守るべきもの」とリソースを見極める

Mac miniのエコシステムによって、ローカルLLMは誰もが手の届く技術になりました。「機密情報を絶対に外に出さない」という点において、このアプローチが最強であることに変わりはありません。

しかし、大半の一般的な事業会社にとって、自社で「小さなAI開発・運用会社」を抱え込むようなこの泥沼に足を踏み入れることは、あまり推奨されません。 「機密情報を守りたい」のであれば、自作の運用地獄に陥る前に、Microsoft AzureやAWSなどが提供する「入力データが一切再学習に利用されないエンタープライズ版クラウドサービス」を契約し、閉域網で接続するという選択肢を冷静に比較検討すべきです。

「ハードが安くなったから」という理由だけでローカルLLMに飛びつくのではなく、自社にはそれを継続的に運用できる「人材」と「覚悟」があるのか。リスクとコストの全体像をシビアに見極めることこそが、現代の正しいITマネジメントの姿なのです。

この記事の監修者

石崎 一之進

中小企業診断士

年間50回以上のセミナー・研修に登壇する「Web・ITが得意な中小企業診断士」。単なるツール導入ではなく、経営視点から現場の「業務効率化」と「売れる仕組み」づくりを両輪で伴走支援し、企業の自走を促すDX人材育成に力を入れています。

参考文献

- 独立行政法人情報処理推進機構(IPA)「AI白書」(エッジAI・ローカルAIの動向と運用課題に関する解説) https://www.ipa.go.jp/publish/wp-ai/ai-2020.html