AIに機密情報を入力するとなぜ危険なのか?

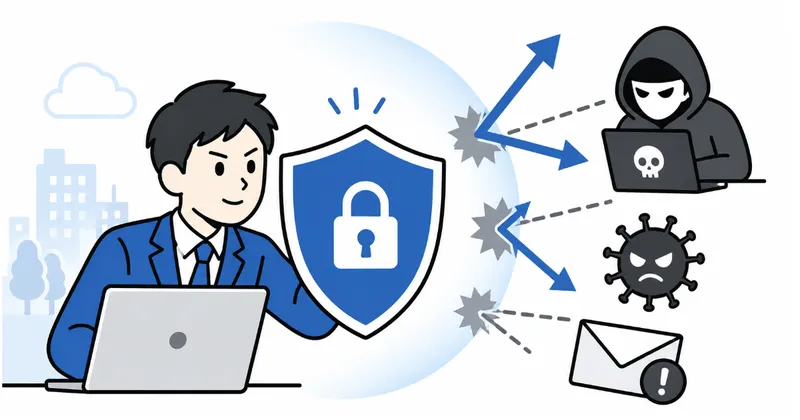

業務効率化のため、AIへ安易に会議の議事録や未公開のプログラムコードを入力していませんか?適切な保護設定がない無料の生成AIなどでは、入力した機密情報がAIの学習データとして吸収され、第三者に漏洩するリスクがあります。本記事では、AI利用に潜む情報漏洩のメカニズムと、絶対に避けるべきNG行動を解説します。

1. 忍び寄る「無意識の」情報漏洩

「今日の会議、内容が多すぎてまとめるのが大変だな。AIに貼り付けて要約してもらおう」 「このプログラムのバグ、どこがおかしいのかAIにチェックさせればすぐ終わるはずだ」

日々の業務の中で、私たちは常に効率化の誘惑に駆られています。生成AIは、こうした面倒な作業を一瞬で片付けてくれる魔法のようなツールに見えます。しかし、その「便利さ」の裏側には、組織の存続を揺るがしかねない巨大な落とし穴が潜んでいます。

多くの人が陥る誤解は、**「AIとのやり取りは、自分と画面の向こうのAIだけの秘密である」**という思い込みです。しかし、適切なセキュリティ設定や法人契約がなされていない環境(一般向けの無料版など)での入力は、たとえ「ちょっとした一言」であっても、全世界に向けて情報を発信しているのと同義になるリスクを孕んでいます。

2. 入力データは「AIの血肉」になる

なぜ、情報を入力することが「漏洩」に直結するのでしょうか。その理由は、生成AIが賢くなる仕組みにあります。

多くの生成AI、特にChatGPTなどの無料版や初期設定のサービスでは、ユーザーが入力したプロンプト(指示文)やデータは、AIモデルをさらに改良・学習させるための「トレーニングデータ」として利用されることがあります。

あなたが入力した「未発表プロジェクトの企画案」や「顧客の不満が記されたメール文」は、AIに取り込まれ、その知識の一部となります。すると何が起きるでしょうか。他者が別の場所でAIに質問をした際、あなたの入力した機密情報に基づいた回答が、AIの口から「知識」として出力されてしまう可能性があるのです。

これは、従来の検索エンジンで検索することとは根本的に異なります。検索は情報を「探す」行為ですが、AIへの入力は情報を「提供し、学習させる」行為なのです。

3. 現実に起きた衝撃の事例

「そんなことは理論上の話で、実際には起きないだろう」と考えるのは危険です。すでに世界中の名だたる企業で、深刻な事例が報告されています。

韓国サムスン電子の事例(2023年)

最も有名な事例の一つは、韓国のサムスン電子で発生したものです。半導体部門のエンジニアが、機密性の高いソースコードのバグを修正するためにChatGPTにコードを貼り付けました。また、別の従業員は内部会議の録音内容を要約させるためにChatGPTに入力しました。 これらは悪意のあるリークではなく、純粋に「業務を効率化したい」という善意からくる行動でしたが、結果として社外秘の高度な技術情報や会議の内容がOpenAI社のサーバーに渡り、学習リソースとして利用され得る状態になってしまいました。同社はこの事態を重く受け止め、直後に生成AIの利用制限や禁止措置を講じることとなりました。

Amazonによる社内警告

米国Amazonでも、従業員に対して「ChatGPTに機密情報を共有しないよう」強い警告が出されました。同社の法務担当者は、ChatGPTの回答の中に、Amazonの内部データと酷似した出力があることを確認したとされています。これは、すでに誰かが入力した社内情報が、AIの回答プロセスに取り込まれ始めていることを示唆するものでした。

金融機関による一斉制限

JPモルガン・チェース、バンク・オブ・アメリカ、シティグループなどの国際的な金融大手は、AI黎明期にいち早く従業員によるChatGPTの利用を制限しました。顧客の資産情報や取引データを取り扱う金融業界にとって、データの帰属先が不明確なツールに情報を流すことは、コンプライアンス上の致命的な欠陥となるためです。

4. 組織における「3つの具体的リスク」

私たちが「ちょっとだけ」のつもりで入力してしまうデータには、主に以下の3つのリスクが伴います。

- 営業秘密の流出: 新製品のスペック、未公開の提携話、独自のアルゴリズムなどがAIの学習データとなり、競合他社への回答に流用される。

- 個人情報の保護違反: 顧客名、メールアドレス、住所などを含むデータを入力することで、個人情報保護法(GDPR等を含む)に抵触し、組織が巨額の罰金や社会的信用の失墜を招く。

- 契約違反: 取引先から預かっている「秘密保持義務」がある情報をAIに入力した場合、意図せずとも契約違反となり、損害賠償請求の対象となる。

5. 私たちが取るべき「賢い防衛策」

AIを「使わない」ことが正解ではありません。大切なのは、**「組織のルールに従った安全な使い方」**を徹底することです。

- 「法人向け・エンタープライズ版」を利用する: 組織が提供する法人向けAI環境(Azure OpenAI ServiceやChatGPT Enterpriseなど)は、通常、入力データがAIの学習に利用されないよう保護されています。必ず許可された環境で利用しましょう。

- データの「匿名化(マスキング)」を徹底する: どうしてもAIに分析させたい場合は、固有の製品名、個人名、社名は「A社」「プロジェクトX」のように置き換え、万が一流出しても意味をなさない形に加工してから入力します。

- 「公開して良い情報か」を自問する: プロンプトを入力する直前に、一度手を止めてください。「この内容は、駅の掲示板に貼り出せる内容か?」と自問しましょう。もし答えが「NO」であれば、それは入力すべきではありません。

結びに:利便性と責任はセットである

生成AIは、正しく使えば最強の武器になります。しかし、その刃を自分たちに向けてしまうかどうかは、私たち一人ひとりの「リテラシー」にかかっています。

「自分一人くらい」「これくらいの情報なら」という油断が、積み上げてきた組織の信頼を一瞬で崩壊させる可能性があることを忘れないでください。情報を守ることは、あなた自身と、あなたの仕事を守ることに他なりません。

参考文献・資料:

- Samsung internal sensitive data leak via ChatGPT (Bloomberg / Reuters, 2023)

- Amazon warns employees about sharing confidential information with ChatGPT (Business Insider, 2023)

- Wall Street banks restrict employees from using ChatGPT (CNN Business / Financial Times, 2023)

この記事の監修者

石崎 一之進

中小企業診断士

年間50回以上のセミナー・研修に登壇する「Web・ITが得意な中小企業診断士」。単なるツール導入ではなく、経営視点から現場の「業務効率化」と「売れる仕組み」づくりを両輪で伴走支援し、企業の自走を促すDX人材育成に力を入れています。