オプトアウトとオプトイン

AIツールに入力したデータが、AI自身の学習に利用されるかを決める重要な設定「オプトアウト(利用拒否)」と「オプトイン(利用許可)」について解説します。機密情報の漏洩を防ぎ、安全にAIを活用するために、各ツールのデータ取り扱い方針を正しく理解し、適切な設定を行うための基礎知識を身につけましょう。

社内のAI利用ガイドラインや、AIツールの利用規約を読んでいると、頻繁に「オプトアウト」という言葉が登場します。これは、私たちが組織の情報を守りながら安全にAIを利用する上で、絶対に知っておかなければならない「データ利用の許諾」に関する専門用語です。

ここでは、言葉の直訳的な意味だけでなく、「AIを業務で利用する際に、具体的にどのような意味を持つのか」という実践的な視点から解説します。

1. 言葉の基本的な意味

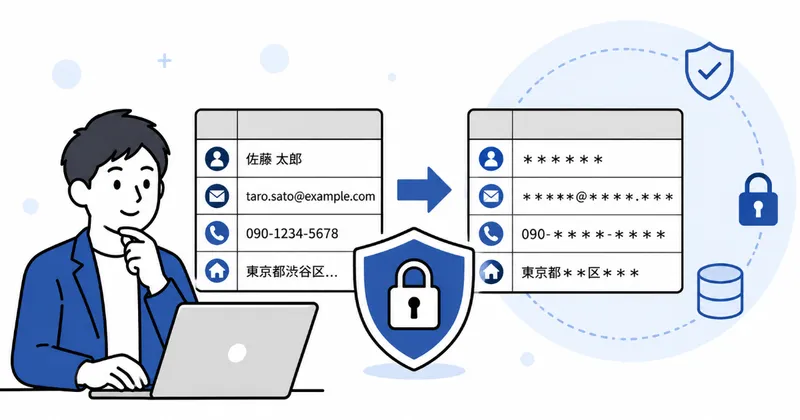

まずは、言葉の根本的な定義から確認しましょう。どちらもITの分野でよく使われる「ユーザーの意思表示(同意や拒否)」に関する用語です。

- オプトイン(Opt-in): 事前に「許可する・同意する」と意思表示をすること。ユーザー側が自らチェックボックスにチェックを入れるなどして「はい」と明示しない限り、企業側はデータの収集や利用を開始できないという仕組みです。

- オプトアウト(Opt-out): 事前に「拒否する・停止する」と意思表示をすること。ユーザー側が自ら設定を変更して「いいえ」と言わない限り、企業側はデータを利用してもよい(初期設定で同意しているとみなされる)という仕組みです。

2. AI利用における「オプトアウト」の重要性

なぜ今、生成AIの文脈で「オプトアウト」という言葉がこれほど重要視されているのでしょうか。

それは、現在広く普及している一般向けの無料生成AIサービスの多くが、実質的な「オプトアウト方式」を採用しているからです。

あなたがアカウントを作成し、AIへの質問(プロンプトの入力)を開始した時点で、利用規約上は「入力したテキストやデータを、AIをさらに賢くするためのトレーニング(再学習)に利用してもよい」ということに自動的に同意した状態(初期設定)になっていることがほとんどです。

この初期状態のまま、業務上の未公開情報、ソースコード、あるいは顧客のクレーム内容などを入力してしまうと、そのデータはAIの巨大な脳に「新しい知識」として吸収されてしまいます。そして将来、無関係の第三者が似たような質問をした際に、あなたの入力した機密情報がAIの回答として出力されてしまう(情報漏洩が起きる)リスクが生じます。

これを防ぐための防衛策が「オプトアウト設定」です。AIツールの設定画面から「私のデータは、AIの学習モデルの改善に使わないでください」と意図的に設定(拒否の意思表示)を行うことで、初めてあなたのデータはAIの学習ループから切り離され、保護されます。

3. 具体的な設定方法と「企業向けプラン」の違い

多くの一般向けAIツールでは、利用者が自分でオプトアウトを設定できる機能が用意されています。

- 一般的な設定場所 多くの場合、アカウントの「設定(Settings)」メニュー内にある「データコントロール(Data Controls)」や「プライバシー管理(Privacy)」といった項目に隠れています。そこで「チャット履歴とトレーニング(Chat history & training)」などのスイッチをオフにする操作が、オプトアウトに該当します。

- 企業向けプラン(エンタープライズ版)との違い 会社が多額の費用を払って契約している「法人向けAI環境」や「API(システム間連携)経由での利用」の場合、最初から「顧客の入力データをAIの学習に一切利用しない」という契約になっているのが一般的です。つまり、企業向けプランはデフォルトでデータが保護されているため、個々の従業員がオプトアウト設定を気にする必要がありません。会社が「個人の無料アプリではなく、指定の社内AI環境を使え」と厳命する最大の理由はここにあります。

4. 知っておくべき「オプトアウトの限界」

「オプトアウト設定をしたから、どんな機密情報を入力しても100%安全だ」と考えるのは非常に危険です。オプトアウトには、いくつか注意すべき「限界」が存在します。

- 学習には使われないが、保存はされる オプトアウトをしても、AI提供企業が「不正利用(規約違反や違法なプロンプトの入力)の監視」を目的として、入力データを一定期間(例えば30日間)自社のサーバーに保存し続ける場合があります。データがその瞬間に完全に消滅するわけではありません。

- 規約変更やヒューマンエラーのリスク 無料サービスの場合、提供企業の都合で突然利用規約が変更され、いつの間にか設定の条件が変わっている可能性があります。また、アプリを再インストールしたり、ブラウザの履歴を消去したりした際に、オプトアウト設定がリセットされ、気づかないうちに「学習許可(初期設定)」に戻ってしまう事故も起こり得ます。

5. まとめ:究極のセキュリティ対策

オプトアウト設定は、私たちがAIを利用する際の最低限の「防具」です。しかし、どれほど設定を徹底しても、インターネットを経由して社外のサーバーにデータを送信している以上、リスクを完全にゼロにすることはできません。

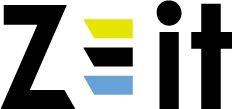

情報漏洩を防ぐための最も確実な対策は、**「そもそも、外部に漏れて困るような機密情報や個人情報(生データ)は、AIに一切入力しないこと」**に尽きます。

どうしても入力したい場合は、固有名詞を「A社」「B氏」に置き換える「マスキング(匿名化)」の手間を惜しまないこと。システムの仕組み(オプトアウト)を正しく理解しつつ、最終的には「人間の判断」で情報を守り抜く姿勢こそが、組織でAIを活用するための最も重要なリテラシーです。

この記事の監修者

石崎 一之進

中小企業診断士

年間50回以上のセミナー・研修に登壇する「Web・ITが得意な中小企業診断士」。単なるツール導入ではなく、経営視点から現場の「業務効率化」と「売れる仕組み」づくりを両輪で伴走支援し、企業の自走を促すDX人材育成に力を入れています。

参考文献

- 個人情報保護委員会「生成AIサービスの利用に関する注意喚起等について」 https://www.ppc.go.jp/files/pdf/230602_kouhou_houdou.pdf