大規模言語モデル(LLM:Large Language Model)

ChatGPTなどのテキスト生成AIの「脳」にあたる仕組みが「大規模言語モデル(LLM)」です。膨大なデータから「次に続く単語の確率」を計算して文章を予測するメカニズムを解説します。この構造を知ることで、AIがもっともらしい嘘(ハルシネーション)をつく理由が腹落ちします。

1. 生成AIの「脳」:LLMとは何か?

私たちがパソコンやスマートフォンから「〇〇について教えて」とAIに質問を投げかけると、まるで人間がタイピングしているかのように、スラスラと自然な日本語が返ってきます。この魔法のような文章生成を裏側で支えている中核システム、いわばAIの「脳」にあたるのが**大規模言語モデル(LLM:Large Language Model)**です。

文字通り、「大規模(Large)」なデータと計算力を用いて構築された、「言語(Language)」を処理するための数理的な「模型・仕組み(Model)」を指します。

近年、AIが急速に実用化された最大の理由は、このLLMの規模が劇的に巨大化したことにあります。インターネット上のありとあらゆるテキスト(Wikipedia、ニュース記事、書籍、ブログ、プログラミングコードなど)を丸ごと飲み込み、途方もないスーパーコンピュータの計算力を使って学習させた結果、AIはかつてないレベルで「人間の言葉のルール」を獲得しました。

2. 驚くべき仕組みは「単語の予測ゲーム」

では、この巨大な脳は、一体どのようにして文章を「考えて」いるのでしょうか。

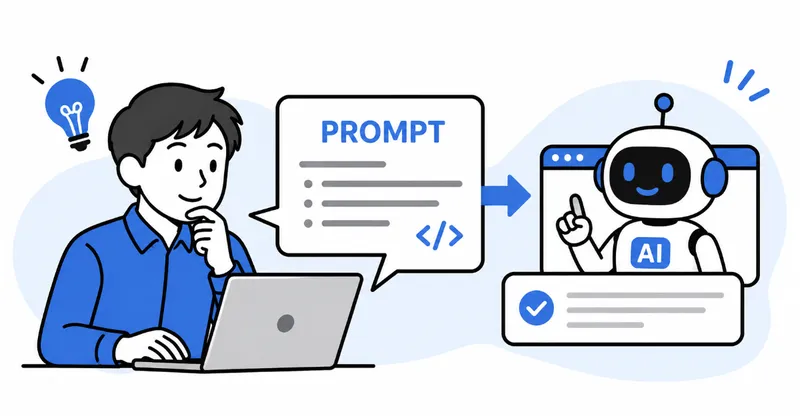

結論から言うと、LLMは私たちの質問の意味を人間のように深く理解し、思考を巡らせているわけではありません。LLMがやっているのは、極めて高度な**「確率に基づいた単語の予測ゲーム(しりとり)」**です。

LLMは、膨大なテキストデータを読み込む過程で、「ある単語の次には、どの単語が続く確率が高いか」という言葉の繋がり(パターン)を徹底的に記憶しています。

例えば、「吾輩は」という入力が与えられた場合、LLMは過去の学習データから次に来る単語の確率を瞬時に計算します。

- 「猫である」(確率 85%)

- 「人間だ」(確率 10%)

- 「犬です」(確率 2%)

この確率計算に基づき、最もふさわしい「猫である」という単語を選び出します。そして今度は「吾輩は猫である」という文章に続く単語を予測し……という作業を、1単語(正確にはトークンと呼ばれる単位)ずつ超高速で繰り返すことで、一本の自然な文章を紡ぎ出しているのです。

3. なぜ「もっともらしい嘘(ハルシネーション)」が生まれるのか

LLMが「確率による予測ゲーム」であることを理解すると、AI利用における最大のリスクである**「ハルシネーション(もっともらしい嘘)」**がなぜ発生するのか、その理由が明確に分かります。

LLMは「事実として正しいかどうか」をデータベースと照合して確認しているわけではありません。あくまで「手持ちの確率データの中で、最も自然に繋がる単語」を選んでいるだけです。 そのため、AI自身が知らない専門的な事柄や、存在しない架空の事象について質問された場合、「分かりません」と答える代わりに、手持ちの単語の確率を無理やりつなぎ合わせ、文法的には完璧で論理的な「架空の回答」を生成してしまうのです。

「AIの回答は常に嘘が混ざる可能性があるため、人間によるファクトチェック(事実確認)が必須である」と社内ルールで厳しく定められているのは、このLLMの確率論的な構造そのものに起因しています。

4. 学習の仕組みがもたらす「情報漏洩」のリスク

LLMのメカニズムを理解することは、もう一つの巨大なリスクである「情報漏洩」を防ぐことにも直結します。

LLMは、一度完成したら終わりではなく、新しく入力されたデータを吸収して「単語の確率の精度(重み付け)」を更新し、さらに賢くなろうとする性質を持っています。 もし、あなたが無料のAIサービスに「A社との未公開の提携プロジェクト」に関する機密の議事録を入力して要約させたとします。するとLLMは、「なるほど、最近のビジネストレンドではA社と提携するという文脈(確率)が高まっているのだな」と学習してしまいます。

その結果、後日、全く無関係の第三者が「A社の最近の動向を教えて」と質問した際、LLMが学習した確率データに基づいて、あなたの入力した機密情報を「最も確率の高い自然な回答」として出力してしまう危険性があるのです。

5. まとめ:ブラックボックスの正体を知る

「魔法のように賢い」と感じていたAIも、蓋を開けてみれば「膨大なデータに基づく確率計算の連続」という、極めて数学的でドライなシステムです。

大規模言語モデル(LLM)というブラックボックスの正体を「単語の予測マシン」として正しく認識すること。それによって初めて、私たちは「AIの嘘に騙されない批判的な目」と「不用意に機密データを入力しない防衛意識」を持つことができます。仕組みを知ることこそが、最強のITリテラシーなのです。

この記事の監修者

石崎 一之進

中小企業診断士

年間50回以上のセミナー・研修に登壇する「Web・ITが得意な中小企業診断士」。単なるツール導入ではなく、経営視点から現場の「業務効率化」と「売れる仕組み」づくりを両輪で伴走支援し、企業の自走を促すDX人材育成に力を入れています。