AIの「偏見(バイアス)」と倫理的リスク:最終的な意思決定に人間が介在すべき理由

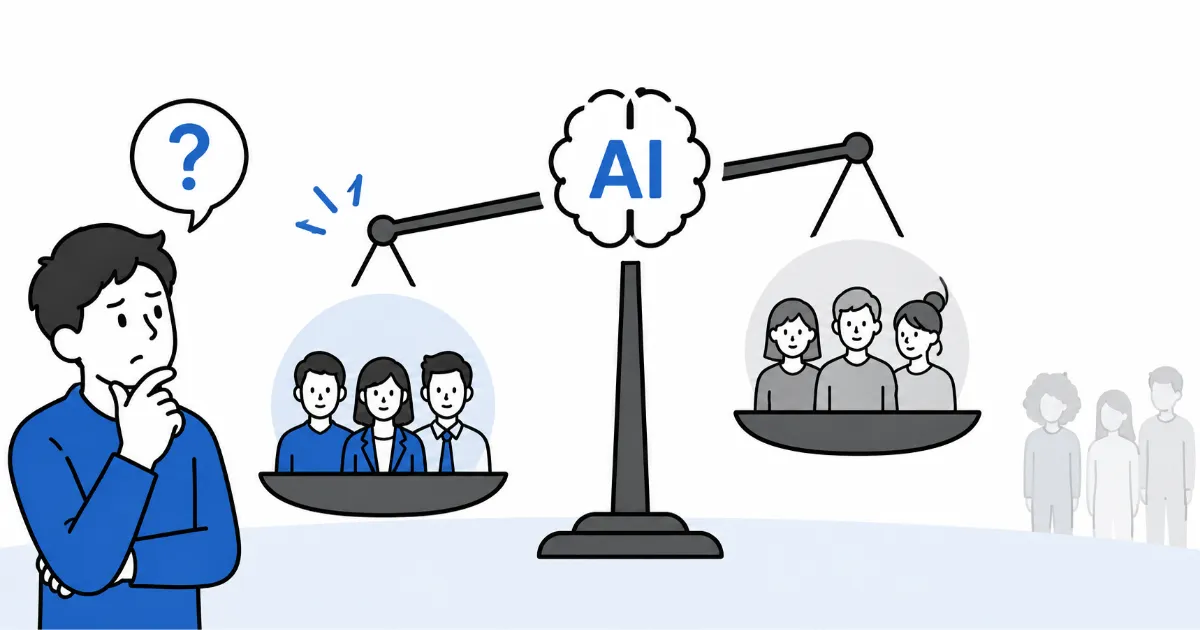

AIは常に客観的で公平だと思っていませんか?実はAIの学習データには、人間の社会が抱える「偏見(バイアス)」が色濃く反映されています。採用や審査など人を評価する業務でAIの判断を鵜呑みにする危険性と、人間の倫理観による最終チェックの重要性を解説します。

1. AIは「中立で公平」という危険な錯覚

「人間は感情や個人的な好みに流されてえこひいきをするが、AIは機械だから常に客観的で、誰に対しても公平な判断を下すはずだ」

AIを業務に導入する際、私たちはしばしばこのような「テクノロジーに対する過信」を抱いてしまいます。確かにAIには、特定の個人に対する個人的な恨みや、意図的な悪意はありません。しかし、だからといって「AIの判断が常に公平である」と考えるのは、非常に危険な錯覚です。

AIの判断を無批判に受け入れ、人事評価、採用活動、与信審査など「人間の人生や権利に直接関わる業務」にそのまま適用した場合、企業は意図せず「深刻な差別的行為」の加害者になるリスクを抱えています。

2. なぜAIは「差別」をするのか?(アルゴリズムバイアスの正体)

感情を持たないはずのAIが、なぜ特定の人種、性別、年齢に対して差別的な出力をするのでしょうか。その答えは、AIが賢くなるための「学習データ」にあります。

AIは、インターネット上のテキストや企業が蓄積してきた過去の膨大なデータを読み込んで学習します。しかし、その「過去のデータ」を作ってきたのは人間です。人間の歴史や社会構造の中には、無意識の偏見、ステレオタイプ、あるいは過去の不平等な慣習が確実に含まれています。

例えば、「過去10年間、我が社で出世した優秀なエンジニアのデータ」をAIに学習させたとします。もしその10年間、IT業界全体が男性中心の社会であり、たまたま男性エンジニアの採用割合が圧倒的に高かった場合、AIはデータを分析した結果、「『男性であること』が、優秀なエンジニアになるための重要な条件である」と誤って学習してしまいます。 これを「アルゴリズムバイアス(AIの偏見)」と呼びます。AIは偏見を「事実(データ)」として純粋に学習し、その偏りをさらに増幅させて未来の判断に適用してしまうのです。

3. 【実例】AIが引き起こした深刻な差別問題

AIのバイアスが実社会で引き起こしたトラブルとして、世界的に有名な事例がいくつか存在します。

AmazonのAI採用ツールによる「女性差別」

2014年、米国Amazonは履歴書を自動でスクリーニングするAIツールの開発を進めていました。しかし、このAIは「女性に対して不利な評価を下す」という致命的な欠陥を持っていることが発覚しました。 過去10年間の履歴書データを学習したAIは、IT業界の男性優位という過去の傾向から「男性の履歴書の方が好ましい」と推論し、「女子チェスチームのキャプテン」や「女子大学」といった女性を示す単語が含まれる履歴書を自動的に減点していたのです。同社はこのシステムの問題を重く受け止め、実運用を前にプロジェクトを破棄しました。

クレジットカードの与信枠における「性別バイアス」疑惑

2019年、米国で提供が開始された「Apple Card(発行元:ゴールドマン・サックス)」において、著名な起業家が「妻と資産や信用情報は全く同じ(共同口座)であるにもかかわらず、自分の与信枠は妻の20倍に設定された」と告発し、大きな非難を浴びました。 アルゴリズムのブラックボックス化により意図的な差別であったかは証明されませんでしたが、「AIによるスコアリングが、見えない形で性別などの属性に偏った評価を下しているのではないか」という社会的な不信感を招き、規制当局が調査に乗り出す事態となりました。

4. 倫理的リスクがもたらす組織への致命傷

もしあなたの会社で、書類選考や顧客の融資審査を「AIのスコアだけで自動的に決定するシステム」を導入し、それが特定の属性に対する差別を含んでいた場合、どうなるでしょうか。

「AIが勝手にやったことで、私たちに差別する意図はなかった」という言い訳は、法廷や社会に対して一切通用しません。企業は、人権侵害や不当な差別を行ったとして激しい社会的非難を浴び、ブランドイメージは失墜し、甚大な損害賠償や法的制裁を受けることになります。昨今のSDGsやESG経営(環境・社会・ガバナンスを重視する経営)が求められる社会において、倫理的リスクの軽視は企業の存続そのものを危ぶませる致命傷です。

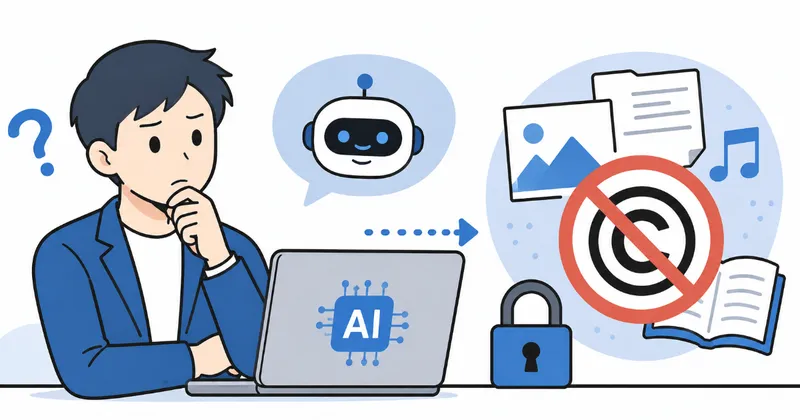

5. 必須の安全設計「Human in the loop(人間の介在)」

AIのバイアスを完全にゼロにすることは、現在の技術では極めて困難です。だからこそ、AIを業務に導入する際に絶対に必要な安全設計の概念があります。それが**「Human in the loop(ヒューマン・イン・ザ・ループ:人間の介在)」**です。

これは、システムが処理を行う過程、特に「最終的な意思決定」のループの中に、必ず人間を組み込むという考え方です。 AIは過去のデータから「傾向」を算出する優秀なアシスタントですが、そのAIが「なぜその結論に至ったのか」を最終的に確認し、そこに不当な差別や倫理的な問題が含まれていないかを判断するのは、倫理観を持った人間にしかできません。

- AIが作成した「不採用通知リスト」をそのまま自動送信するのではなく、必ず採用担当者が一度目を通し、不自然な偏りがないか確認する。

- AIが「融資不可」と判定した顧客に対して、その根拠が年齢や性別などの属性による不当なものではないか、人間の担当者がレビューを行う。

このように、重要な判断をAIに「丸投げ」しないことが、最大の防衛策となります。

6. 結びに:私たち自身の倫理観が問われている

AIという最先端のテクノロジーは、皮肉なことに「人間の社会がいかに偏見に満ちているか」を鏡のように映し出しています。

AIには、思いやりも、道徳も、倫理観もありません。それらを持ち合わせているのは、AIを利用する私たち人間だけです。AIの出力結果を前にしたとき、「この判断は本当に公平か?」「誰かを不当に傷つけていないか?」と問いかけることができるのは、人間しかいないのです。

AIの判断を無批判に受け入れることは、自らの思考と倫理的責任を放棄することに等しいと言えます。どれほどAIが便利になろうとも、最終的な意思決定の責任は人間が負う。この「Human in the loop」の原則を日々の業務に組み込むことこそが、AIを安全に使いこなし、社会から信頼される組織であり続けるための絶対条件です。

この記事の監修者

石崎 一之進

中小企業診断士

年間50回以上のセミナー・研修に登壇する「Web・ITが得意な中小企業診断士」。単なるツール導入ではなく、経営視点から現場の「業務効率化」と「売れる仕組み」づくりを両輪で伴走支援し、企業の自走を促すDX人材育成に力を入れています。

参考文献

- Reuters: "Amazon scraps secret AI recruiting tool that showed bias against women" (2018年10月11日) https://www.reuters.com/article/us-amazon-com-jobs-automation-insight-idUSKCN1MK08G/

- Bloomberg: "Apple Card Algorithm Sparks Gender Bias Allegations Against Goldman" (2019年11月9日) https://www.bloomberg.com/news/articles/2019-11-09/apple-card-algorithm-sparks-gender-bias-allegations-against-goldman