Human in the loop(ヒューマン・イン・ザ・ループ / 人間の介在)

AIに業務を完全に自動化させるのではなく、プロセスの重要箇所(特に最終決定)に必ず人間を介在させる「Human in the loop(人間の介在)」という安全設計の概念を解説します。AIの暴走や倫理的リスクを防ぎ、最終的な「責任」を人間が担うための必須要件です。

1. AI導入のゴールは「完全な自動化」ではない

「AIを導入すれば、人間の仕事は完全に自動化され、人間は何もしなくてよくなる」。AIという言葉から、工場で全自動で稼働するロボットのようなものを想像し、すべてのプロセスから人間を排除することが「究極の効率化」であると考える人は少なくありません。

しかし、現在の生成AIを用いたビジネス業務において、この「完全自動化(人間の排除)」を目指すことは極めて危険です。これまでのコラムや用語解説で学んだ通り、AIは事実誤認(ハルシネーション)を起こし、学習データに含まれる偏見(バイアス)を再生産するリスクを抱えています。

AIに重要な意思決定までを「丸投げ」し、人間がチェックしない仕組みを作ってしまうと、AIが引き起こした事故や差別の被害がそのまま顧客や社会に直撃してしまいます。この悲劇を防ぐための最も重要な安全設計の概念が、**「Human in the loop(ヒューマン・イン・ザ・ループ:人間の介在)」**です。

2. Human in the loop(HITL)とは何か?

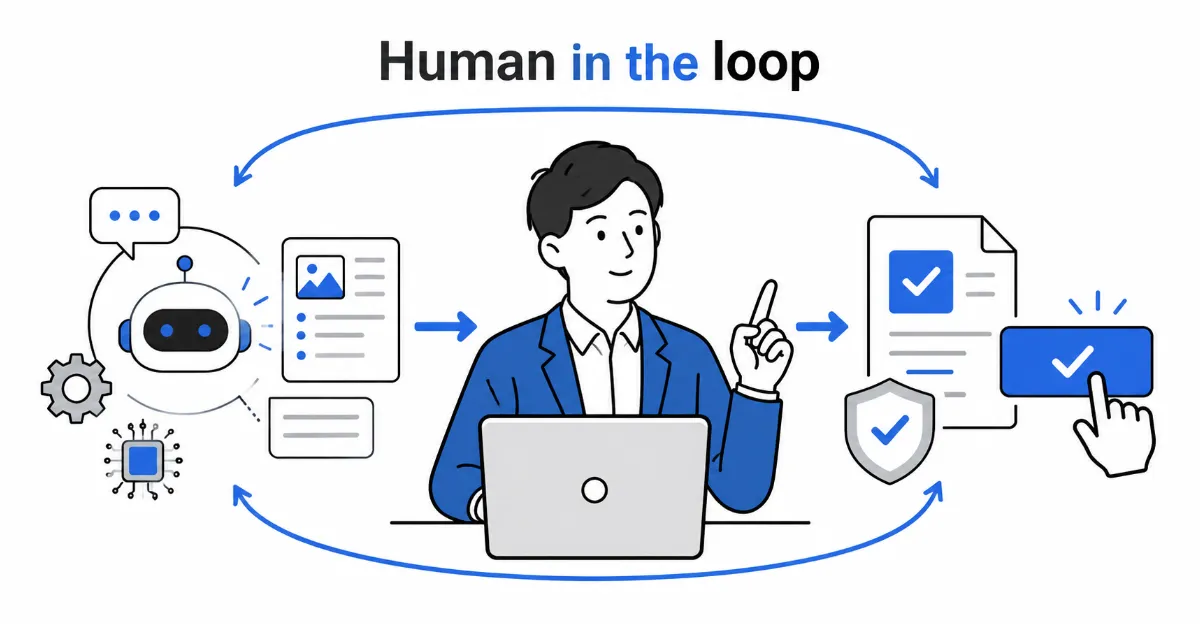

Human in the loop(以下、HITL)とは、直訳すると「ループ(処理の輪)の中に人間がいる状態」を指します。

AIシステムがデータを読み込み、分析し、結果を出力する一連の処理プロセス(ループ)において、AI単独で処理を完結させるのではなく、「人間による確認、修正、承認」というステップを必ずシステムの一部として組み込む設計のことです。

例えば、「AIが顧客からのクレームメールを読み込み、返信文を作成して、自動で送信する」というシステムは、人間が介在していないため「Human out of the loop(ループ外)」であり、大事故に繋がる危険な設計です。 これをHITLの設計にする場合、「AIが返信文のドラフト(下書き)を作成する」ところまでをAIの自動処理とし、「そのドラフトを人間の担当者が読み、内容の正確性と感情的な配慮が適切かをチェックし、人間が送信ボタンを押す」というフローに変更します。

3. なぜ「人間の介在」が絶対に不可欠なのか?

業務プロセスに人間を介在させるべき理由は、大きく3つあります。

- ① コンテキスト(文脈)と倫理の補完: AIは文字通りのデータ処理は得意ですが、「その言葉が今の社会情勢においてどう受け取られるか」「相手の感情を逆撫でしないか」といった、人間特有の高度な文脈や倫理観を持っていません。ここを補えるのは人間だけです。

- ② 予期せぬエラー(例外)への対応: AIの学習データに存在しない全く新しいケースや、AIがハルシネーションを起こして暴走した際、それを異常だと直感的に察知してブレーキを踏む「安全装置」の役割を果たします。

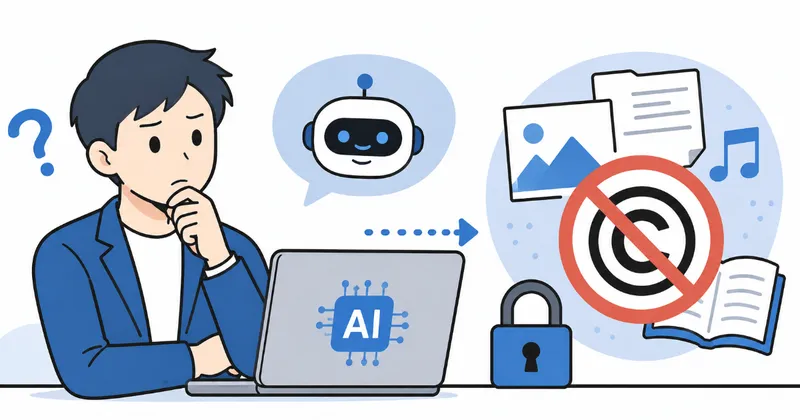

- ③ 「責任の所在」の明確化(最も重要): AIには法人格がなく、裁判で裁かれることも、顧客に謝罪することもできません。最終的な意思決定の瞬間に人間が介在し、「この内容でヨシ」と承認(ハンコを押す)ことで初めて、その出力結果に対する法的・社会的な「責任の主体」が人間(および企業)に帰属するのです。

4. 人間の役割は「作業者」から「編集者・監督者」へ

HITLを導入すると、「せっかくAIを入れたのに人間がチェックする手間がかかる」と感じるかもしれません。しかし、それは人間から仕事が奪われたのではなく、仕事の質(ステージ)が変化した証拠です。

これからの時代、ゼロから文章を書いたり、膨大なデータを集計したりする「作業(クリエーション)」はAIの役割になります。人間の役割は、AIが高速で作成した70点〜80点の下書きをチェックし、事実確認(ファクトチェック)を行い、自社の理念や倫理観というフィルターを通して100点に仕上げる「編集者(エディター)」や「監督者」へとシフトします。

- 採用業務: AIが候補者の履歴書を要約し、人間が面接で最終的なポテンシャルや人間性を評価して採用を決定する。

- 法務業務: AIが契約書のリスク箇所を自動でリストアップし、人間の法務担当者が自社の戦略と照らし合わせて最終的な修正案を確定する。

このように「作業・分析はAI、意思決定は人間」という切り分けを徹底することが、実務におけるHITLの基本です。

5. 規制当局も求める「人間の監視」

このHITLの概念は、単なる企業の自主的な心がけにとどまらず、世界的な法規制の潮流になりつつあります。

例えば、欧州連合(EU)で成立した包括的なAI規制法(AI Act)では、人々の生命や権利に重大な影響を与える「ハイリスクAI(医療、採用、重要インフラ、法執行など)」に対して、システムが適切に機能しているかを人間が監視すること(Human oversight)を法的に義務付けています。日本国内の政府ガイドラインにおいても、AIの出力結果に対する人間の確認と、責任の所在を明確化することが企業に強く求められています。

6. まとめ:AIを「手放し運転」しない責任

自動運転の車に乗っているとき、システムがどれほど優秀でも、万が一の危険や予期せぬ障害物に備えていつでもハンドルを握って修正できる状態にしておく責任が、運転席に座る人間にはあります。AIの業務利用も全く同じです。

どんなにAIが便利になろうとも、AIに「手放し運転(完全自動化)」をさせてはなりません。AIという強力なエンジンのループの中に常に身を置き、最終的な責任者としてコントロールの主導権を握り続けること。この「Human in the loop」の原則を組織のルールとして根付かせることが、AIの恩恵を最大限に引き出しつつ、企業と顧客を守るための最も確実な道となります。

この記事の監修者

石崎 一之進

中小企業診断士

年間50回以上のセミナー・研修に登壇する「Web・ITが得意な中小企業診断士」。単なるツール導入ではなく、経営視点から現場の「業務効率化」と「売れる仕組み」づくりを両輪で伴走支援し、企業の自走を促すDX人材育成に力を入れています。

参考文献

- 経済産業省・総務省「AI事業者ガイドライン(第1.0版)」(人間の関与、Human-in-the-loopに関する言及) https://www.meti.go.jp/shingikai/mono_info_service/ai_shakai_jisso/pdf/20240419_1.pdf