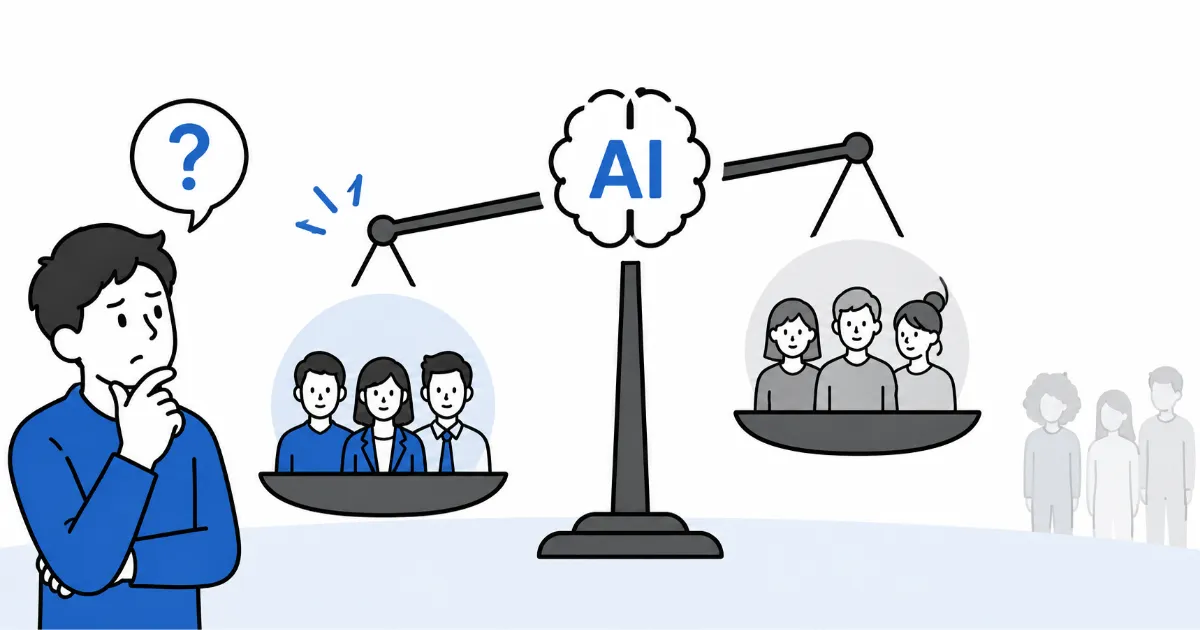

アルゴリズムバイアス(AIの偏見)

AIは客観的で公平だという認識は危険です。「アルゴリズムバイアス(AIの偏見)」とは、AIの学習データに含まれる人間の無意識の偏見や社会の不平等を、AIが「事実」として純粋に学習し、不公平な判断(差別)を増幅・再生産してしまう現象です。このメカニズムと組織が負うリスクを解説します。

1. 「機械は常に客観的である」という神話

私たちが日常業務で何らかの判断(採用、評価、審査など)を下すとき、そこにはどうしても「人間の主観」や「感情」が入り込んでしまいます。「AIは機械だから感情がなく、データに基づいた客観的で公平な判断をしてくれるはずだ」。AIの導入にあたり、多くの人がこのような期待を抱きます。

しかし、これは非常に危険な神話(思い込み)です。

実際には、AIの判断や出力結果には、特定の性別、人種、年齢、国籍などに対して不公平な傾向が現れることが多々あります。このように、AIのアルゴリズム(計算手順)が、特定のグループに対して意図せず不当な差別や偏見を持った結果を出力してしまう現象を、「アルゴリズムバイアス(AIの偏見)」と呼びます。

2. ゴミを入れればゴミが出てくる(Garbage In, Garbage Out)

なぜ、感情も悪意も持たないはずのAIが「偏見」を持つのでしょうか。その答えは、IT業界で古くから言われている**「Garbage In, Garbage Out(ゴミを入れれば、ゴミが出てくる)」**という言葉に集約されます。

AIは、何もないところから自立して思考しているわけではありません。インターネット上の膨大なテキストや画像、あるいは企業が長年蓄積してきた「過去のデータ」を読み込み、そこからパターンを見つけ出すことで賢くなります。 つまり、AIの価値観や判断基準は、与えられた「学習データ」の品質に完全に依存しています。

もし、その学習データの中に「偏見」という名のゴミが混ざっていたら、AIの出力結果も当然「偏見に満ちたもの(ゴミ)」になってしまうのです。

3. バイアスが生まれるメカニズム:「過去の不平等」の学習

では、学習データに混ざっている「偏見」とは何でしょうか。それは他でもない、**「私たち人間の歴史と社会構造に潜む、無意識の偏見や不平等」**そのものです。

具体的な例で考えてみましょう。ある企業が、過去20年間の「自社で高く評価された優秀な管理職のデータ」をAIに学習させ、新しい管理職候補を自動でリストアップするシステムを作ろうとしたとします。 もしこの企業が、過去20年間にわたって「男性中心の企業文化」であり、たまたま管理職の95%が男性だった場合、その過去データには明確な「性別による偏り」が存在します。

しかしAIには、「昔は男性優位の社会構造だったからだ」という時代背景や倫理的文脈を読み取る能力はありません。AIはデータを純粋な数理モデルとして処理し、**「なるほど、『男性であること』が優秀な管理職になるための重要な成功要因なのだな」**と誤って学習(相関関係と因果関係の混同)をしてしまいます。

その結果、新しく女性の候補者のデータが入力された際、AIは「過去の成功パターン(男性であること)に当てはまらない」という理由だけで、不当に低い評価を下してしまうのです。

4. 偏見の「増幅」と「再生産」という恐怖

アルゴリズムバイアスの真の恐ろしさは、偏見をそのまま反映するだけでなく、それを**「増幅」させ、「再生産」してしまう**点にあります。

例えば、画像生成AIに「企業のCEO(最高経営責任者)」の画像を描かせるプロンプトを入力すると、出力される画像の多くが「スーツを着た白人男性」に偏る傾向が指摘されています。これは、インターネット上に存在するCEOの画像の多くが実際に白人男性であるというデータセットの偏りを、AIがそのまま反映しているためです。

もし人々が「AIの出力は客観的で正しい」と信じ込み、このシステムをそのまま使い続ければどうなるでしょうか。AIによって不当に低く評価された属性の人々は、社会的なチャンス(採用、融資など)を奪われ続けます。そして「やはりその属性の人々は実績を出せない」という新たなデータが蓄積され、それが再びAIに学習されるという、悪夢のような「差別の強化ループ」が完成してしまいます。

5. 組織が直面する倫理的リスクと法的責任

業務においてAIのバイアスを放置することは、企業にとって致命的な倫理的リスク(レピュテーションリスク)となります。

採用活動での書類選考、金融機関でのローンの与信審査、不動産の入居審査など、人間の人生を左右する意思決定においてAIのバイアスが発覚した場合、「AIの計算結果だから仕方ない」「我々に差別する意図はなかった」という言い訳は一切通用しません。 企業は「不当な差別を行った組織」として社会から激しい非難を浴び、ブランドイメージは失墜し、場合によっては人権侵害に関する法的責任や巨額の損害賠償を問われることになります。現代のSDGsやESG経営において、アルゴリズムバイアスの軽視は企業の存続そのものを揺るがす重大な問題です。

6. まとめ:データと出力を「疑う」人間の責任

AIは「人間の社会を映す鏡」です。AIのアルゴリズムバイアスは、AIという機械の欠陥というよりも、私たち人間社会が抱える偏見がそのままデータとして可視化された結果に過ぎません。

バイアスを完全にゼロにすることは、現在の技術では困難です。だからこそ、AIを業務で利用する私たちには以下の姿勢が求められます。

- データには必ず偏りがあると疑うこと: AIが提示した「もっともらしい評価や結論」を見たとき、それを鵜呑みにせず、「特定の属性に対する偏見が含まれていないか」を批判的な目で確認する。

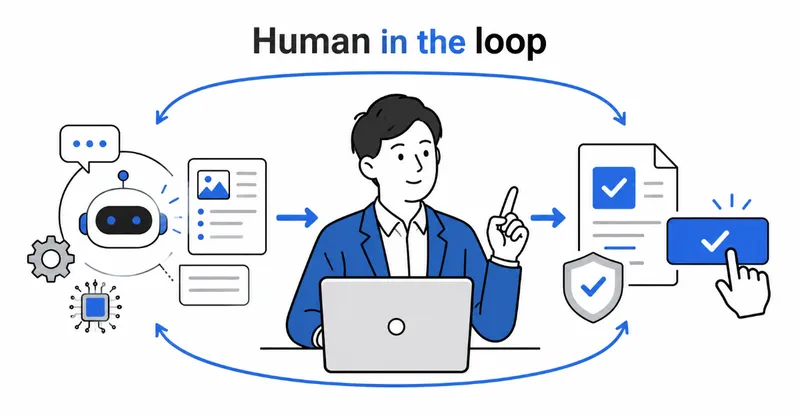

- 最終的な判断は人間が行う(Human in the loop): 人の評価や人生に関わる重要な意思決定をAIに丸投げせず、必ず「人間の倫理観と責任感」による最終チェックを組み込む。

AIはあくまで強力な「計算ツール」であり、「倫理的判断」を下せるのは人間だけです。この前提を忘れないことこそが、アルゴリズムバイアスという目に見えない罠から組織を守るための絶対条件となります。

この記事の監修者

石崎 一之進

中小企業診断士

年間50回以上のセミナー・研修に登壇する「Web・ITが得意な中小企業診断士」。単なるツール導入ではなく、経営視点から現場の「業務効率化」と「売れる仕組み」づくりを両輪で伴走支援し、企業の自走を促すDX人材育成に力を入れています。

参考文献

- 総務省「AIネットワーク社会推進会議 報告書」(AIの公平性・バイアスに関する議論) https://www.soumu.go.jp/main_sosiki/kenkyu/ai_network/index.html

- 経済産業省「AI原則実践のためのガバナンス・ガイドライン」 https://www.meti.go.jp/shingikai/mono_info_service/ai_shakai_jisso/pdf/20220128_1.pdf