「無料AIサービス」と「法人向けAI環境」の決定的な違いとデータ保護の仕組み

個人向けの無料AIサービスと会社が提供する法人向けAI環境の最大の違いである「データの学習利用の有無」について解説します。無料ツールにおける情報漏洩リスクと、法人向け環境が厳格な契約に基づき機密データを保護する仕組みを理解し、指定環境を利用する重要性を学びます。

コラム2:「無料AIサービス」と「法人向けAI環境」の決定的な違いとデータ保護の仕組み

スラグ案: difference-between-free-ai-and-enterprise-ai

【概要】 個人向けの無料AIサービスと会社が提供する法人向けAI環境の最大の違いである「データの学習利用の有無」について解説します。無料ツールにおける情報漏洩リスクと、法人向け環境が厳格な契約に基づき機密データを保護する仕組みを理解し、指定環境を利用する重要性を学びます。(128文字)

1. 「見た目」は同じでも「裏側の仕組み」が異なる

生成AIの普及に伴い、PCやスマートフォンから誰でも簡単に高度なAIツールを利用できるようになりました。こうした中、業務においても「自分のスマートフォンに入っている無料のAIアプリの方が使い慣れている」「会社のシステムはログインが手間で面倒だ」と感じる従業員も少なくないでしょう。

一見すると、個人の無料AIも会社が提供するAIも、同じように質問に答え、文章を生成してくれます。出力される回答のクオリティに大きな差がないように見えるため、「なぜわざわざ使い勝手の異なる会社のシステムを使わなければならないのか」という疑問が生じるのは自然なことです。

しかし、この両者には、画面の見た目やAIの性能以上に、ビジネスツールとして極めて重要な「決定的な違い」が存在します。それは、システムを裏側で支える「契約」と「データの取り扱い(プライバシー保護)」に関する仕組みの違いです。

2. 無料AIサービスにおける「データ二次利用」のリスク

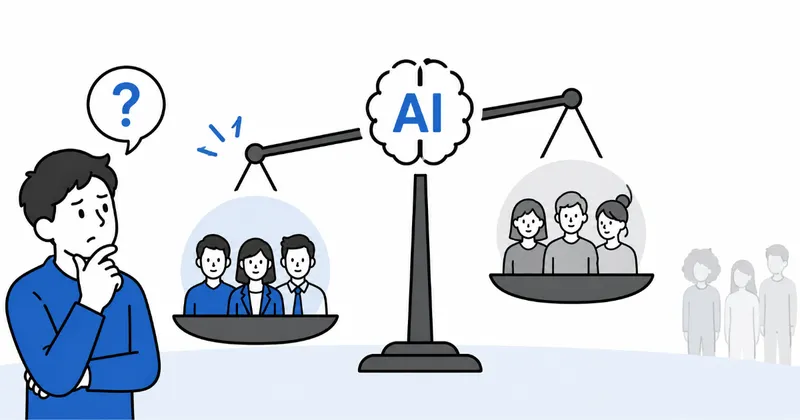

個人向けの無料AIサービス(コンシューマー向けプラン)は、なぜ高度な技術を無償で提供できるのでしょうか。その理由の大きな一つは、ユーザーが入力したデータを、AIモデルの性能向上(再学習)のためのデータとして利用しているからです。

多くの無料AIサービスの利用規約には、「ユーザーが入力したプロンプト(指示文)やアップロードしたデータを、サービスの改善や新たなAIモデルの開発のために利用することに同意する」といった主旨の内容が含まれています。

もし、業務効率化を目的として、未発表の新製品に関する企画書や、顧客との商談の議事録、システム開発のソースコードなどを無料AIに入力してしまった場合、どうなるでしょうか。その機密データは、AIの学習用データとしてサービス提供企業のサーバーに蓄積されます。そして後日、全く無関係の第三者が関連する質問をAIに投げかけた際、あなたが入力した機密情報が「回答」の一部としてそのまま出力されてしまう可能性があるのです。

これを「意図せぬ情報漏洩」と呼びます。個人利用の範囲では問題になりませんが、業務において企業の機密情報や個人情報を扱う場合、この仕様は重大な情報漏洩インシデントを引き起こす原因となります。

3. 法人向けAIが担保する「データ保護の確約」

一方、会社が多額のコストをかけて導入している「法人向けAI環境(エンタープライズ版や、API連携を用いた自社専用システム)」は、データの取り扱いに関する根本的なルールが異なります。

法人向けAIの最大の価値は、**「顧客(企業)が入力したデータは顧客のものであり、AI提供企業のモデル学習(再学習)には一切利用されない」**という法的な確約と、技術的な制限が設けられている点にあります。

会社が契約している法人向け環境(テナントと呼ばれる他社から隔離された専用領域など)を利用する場合、入力されたデータは処理が完了した後に適切に破棄されるか、企業が管理する保護された環境内のみに留まります。外部のAIモデルの「知識」として吸収されることはありません。

また、会社独自の社内システムにAI機能を組み込む際に利用される「API(Application Programming Interface)連携」も同様です。APIとは、システム同士を接続するための専用の通信窓口です。一般向けのWebブラウザ画面からAIに入力するのとは異なり、APIを経由して送信されたデータは、利用規約によって学習への利用が原則として除外されています。情報システム部門は、こうした安全な経路を確保した上で社内環境を構築しています。

会社は、より賢いAIを使うためだけに多額の投資をしているわけではありません。従業員が業務データを入力しても、それが絶対に外部の学習に流出しないという「厳格なセキュリティ基盤」を購入しているのです。

4. 「個人のオプトアウト設定」では不十分な理由

「無料AIでも、設定画面から『履歴を学習させない(オプトアウト)』という設定をオンにすれば安全ではないか?」と考える方もいるかもしれません。確かに、一部のサービスでは個人で学習を拒否する設定が可能です。

しかし、企業という組織において、機密情報の保護を「従業員個人の手動設定」に依存することは、情報セキュリティ管理上、許容されません。

設定をオンにするのを忘れてしまうヒューマンエラーのリスクはもちろんのこと、サービス提供側の規約変更やシステムのアップデートによって、いつの間にか設定がリセットされ、学習が有効になってしまう(サイレント変更)リスクも存在します。 企業が社会的責任を果たすためには、個人の裁量やミスが介在する余地を排除し、システムレベルで一括して「学習不可」が担保された環境(法人向けAI)を利用することが不可欠なのです。

5. まとめ:コストは「安心と信頼の担保」である

個人の無料AIと会社指定の法人向けAIの違いは、単なる機能や使い勝手の差ではありません。「組織の情報資産を守り、コンプライアンスを遵守できる環境かどうか」という、ビジネスツールとしての適格性の違いです。

会社が提供する環境は、従業員が意図せず情報漏洩の加害者になってしまうリスクを防ぐための重要なインフラです。ログインの手間や社内ネットワーク経由でのアクセスなど、利用においてルールが存在することには、すべて組織と従業員を守るための明確な理由があります。

業務で生成AIを活用する際は、個人の判断で無料ツールを使用するのではなく、必ず会社が指定・提供する公式環境を利用すること。この原則の背景にある「データ保護の仕組み」を正しく理解し、実践することが求められます。

この記事の監修者

石崎 一之進

中小企業診断士

年間50回以上のセミナー・研修に登壇する「Web・ITが得意な中小企業診断士」。単なるツール導入ではなく、経営視点から現場の「業務効率化」と「売れる仕組み」づくりを両輪で伴走支援し、企業の自走を促すDX人材育成に力を入れています。

参考文献

- 総務省・経済産業省「AI事業者ガイドライン(第1.0版)」(データの利用目的と学習用データセットに関する言及) https://www.meti.go.jp/shingikai/mono_info_service/ai_shakai_jisso/pdf/20240419_1.pdf