ハルシネーション(Hallucination / 幻覚)

生成AIが事実とは異なる架空の情報を、あたかも真実であるかのように生成する現象「ハルシネーション」について解説します。AIは事実を検索しているのではなく、確率で単語を繋ぎ合わせているため、構造上この嘘を完全に防ぐことはできません。

1. ハルシネーションとは何か?

「ハルシネーション(Hallucination)」とは、元々は医学や心理学の用語で「幻覚」を意味する言葉です。AI(人工知能)の分野においては、**「生成AIが、事実とは異なる情報や、全く存在しない架空の情報を、あたかも真実であるかのように出力してしまう現象」**を指します。

例えば、「日本の第100代内閣総理大臣は誰ですか?」と質問した際に、実在しない架空の政治家の名前を、もっともらしい経歴とともに自信満々に答えてしまうようなケースです。他にも、存在しない法律の条文をでっち上げたり、架空の企業の売上データを緻密な表形式で出力したりと、そのパターンは多岐にわたります。

人間であれば、自分の知らないことを聞かれたら「分かりません」と答えるのが普通です。しかし、生成AIは「分からない」と答えるのが非常に苦手であり、知ったかぶりをして堂々と嘘をついてしまう厄介な性質を持っています。

2. 人間の「嘘」との決定的な違い

ハルシネーションを理解する上で重要なのは、**「AIには、人間を騙そうとする悪意は一切ない」**ということです。

人間が嘘をつくときは、「本当の事実」を知った上で、相手を意図的に欺くために違うことを言います。しかし、AIはそもそも「本当の事実とは何か」「自分が今、嘘をついているか」という概念すら持っていません。AIの出力には悪意もなければ、真実を伝えようとする誠実さもありません。ただシステムとして、与えられた指示に対して「それらしい回答」を自動的に出力しているだけなのです。

3. なぜハルシネーションは起きるのか?(構造上の理由)

なぜ、これほどまでに高度な最新テクノロジーが、簡単に嘘をついてしまうのでしょうか。その理由は、AI(大規模言語モデル)が文章を生成する「根本的な仕組み」にあります。

これまでの用語解説でも触れた通り、生成AIは「インターネット上の事実を検索して、コピペしてきている」わけではありません。AIが行っているのは、膨大な過去のデータをもとにした**「次に続く単語の確率的な予測ゲーム」**です。

例えば、「徳川家康は江戸幕府を」という入力があれば、次に「開いた」という単語が続く確率が最も高いと計算し、文章を繋ぎ合わせます。 しかし、AIの学習データの中に十分な情報がないニッチな質問や、そもそもこの世に存在しない事柄について質問された場合、AIは計算に困ってしまいます。それでもAIはシステム上「何らかの文章を生成しなければならない」ため、手持ちのデータの中から確率的に自然に繋がりそうな単語を無理やり選び出し、パズルのようにはめ込んでしまいます。

その結果、「文法的には完璧で論理的だが、事実としては完全に間違っている(=もっともらしい嘘)」というハルシネーションが生み出されるのです。

4. 「検索」と「生成」の混同が引き起こす悲劇

私たちがハルシネーションに騙されてしまう最大の原因は、無意識のうちに生成AIを「Googleのような検索エンジン」と同じものだと思い込んでいることにあります。

検索エンジンは、この世界にすでに存在するWebページ(情報)をそのまま引っ張ってくる「事実のインデックス(目次)」です。一方、生成AIは、ゼロから新しい文章を紡ぎ出す「クリエイター」です。両者は全く異なるツールです。

クリエイターに対して「正確な事実だけを教えてください」と要求するのは、小説家に歴史の教科書を書かせるようなものです。AIの回答を「検索結果」として鵜呑みにし、業務上の重要な意思決定や顧客への資料作成にそのまま流用してしまうと、重大なコンプライアンス違反や信用失墜に直結します。

5. 完全に防ぐことはできないという「前提」

現在、世界中のAI開発企業がこのハルシネーションを減らすための技術開発(RAG:検索拡張生成など、外部データベースと連携させる技術)に莫大な投資を行っています。これにより、以前に比べて明らかな嘘は減ってきています。

しかし、どれほど技術が進化しても、AIが「確率で単語を繋ぎ合わせる」という根本的な仕組みで動いている以上、ハルシネーションを100%完全に防ぐことは不可能だと言われています。

つまり、私たちが業務でAIを利用する際の絶対的な前提は、「AIは必ず一定の確率で嘘をつくツールである」ということです。「今回は正しいだろう」「このAIは最新版だから大丈夫だろう」という油断は禁物です。

6. まとめ:疑う力こそが最強のリテラシー

ハルシネーションのリスクを前にして、「嘘をつくなら怖くて使えない」とAIを完全に遠ざけるのも、正しいアプローチとは言えません。AIは、文章の要約やアイデア出しといった「事実性を厳密に問われないタスク」においては、間違いなく人間を凌駕するパフォーマンスを発揮します。

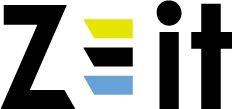

大切なのは、AIの弱点を正しく理解し、人間がそれを補うことです。 AIが出力したもっともらしい回答に直面したとき、「本当にそうか?」「データの一次ソース(根拠)はどこにあるのか?」と健全な疑いを持ち、自らの目でファクトチェック(事実確認)を行うこと。この「疑う力」こそが、AI時代における最も重要で、絶対に欠かすことのできないITリテラシーなのです。

この記事の監修者

石崎 一之進

中小企業診断士

年間50回以上のセミナー・研修に登壇する「Web・ITが得意な中小企業診断士」。単なるツール導入ではなく、経営視点から現場の「業務効率化」と「売れる仕組み」づくりを両輪で伴走支援し、企業の自走を促すDX人材育成に力を入れています。